PPT-OpenMP

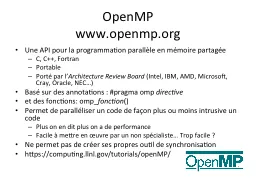

wwwopenmporg Une API pour la programmation parallèle en mémoire partagée C C Fortran Portable Porté par l Architecture Review Board Intel IBM AMD Microsoft Cray

Download Presentation

"OpenMP" is the property of its rightful owner. Permission is granted to download and print materials on this website for personal, non-commercial use only, provided you retain all copyright notices. By downloading content from our website, you accept the terms of this agreement.

Presentation Transcript

Transcript not available.